导读:

在Reddit网站有一个热门讨论,人们是否在优化自己的行为以迎合和对齐算法?答案是肯定的。人类希望AI向自己的目标和价值观对齐,与此同时,人却越来越像机器。

黄磊|撰文

全球顶尖AI实验室正倾注巨资,试图让人工智能的目标与人类价值观保持一致。这项工作被称为对齐。然而,就在工程师、哲学家们与模型的“内在倔强”角力的同时,相关研究显示,人类自身正在不知不觉地向AI靠拢,调整自己的思维、语言,乃至判断方式。

“当我们试图让AI对齐人类时,人类也在被AI重塑,这种双向对齐的复杂性,远超我们最初的想象。”

——Iason Gabriel,谷歌DeepMind伦理研究负责人

人类的工作模式首当其冲。AI普及后,人类的工作时长不仅没有减少,反而有较大提升,同时周末工作的现象也更多。美国ActivTrak生产率实验室发布的《2026年工作状态报告》显示,随着AI的加速普及,职场人日常工作的强度、密度和速度都变得更高,工作负担没有任何减轻,而且需要根据AI来做出调整,人机协作增加了34%,周末工作暴增了40%,但人们可以保持聚焦的时间达到三年新低[1]。

人类的语言和沟通方式,也在不自觉地向人工智能对齐。德国马克思-普朗克人类发展研究所的研究人员矢仓大梦(Hiromu Yakura)发现,自从ChatGPT诞生后,他越来越多的使用“delve”(探究)这个词,而过去研究人员也发现大语言模型正改变书面语的遣词造句,因为写作者可能需要AI来帮助润色论文和报告。

矢仓大梦,德国马克思-普朗克人类发展研究所博士后研究员

矢仓及其同事想知道口头交流是否也同样受到了影响。研究人员首先借助 ChatGPT,对数百万页的电子邮件、随笔、学术文章及新闻报道进行文本改写,使用的都是润色文字、提升表述清晰度这类通用提示词。随后,他们筛选出 ChatGPT 在改写过程中反复高频添加的词汇,例如 delve(深入探究)、realm(领域)、meticulous(细致缜密的),并将这类词汇命名为GPT 专属词汇。

研究团队接着分析了 ChatGPT 问世前后,超 36 万条 YouTube 视频、77.1 万期播客节目,追踪 GPT 词汇随时间的使用变化。他们把 GPT 专属词汇与合成对照组词汇做比对:对照组词汇通过数学加权筛选得出,均是大模型不常使用的同义替换词,比如 delve 的同义替代词examine(审视)、explore(探究)。研究发现,这类 GPT 词汇不仅仅出现在正式、有稿件脚本的视频和播客中,也大量渗透到了日常即兴的口语对话里[2]。

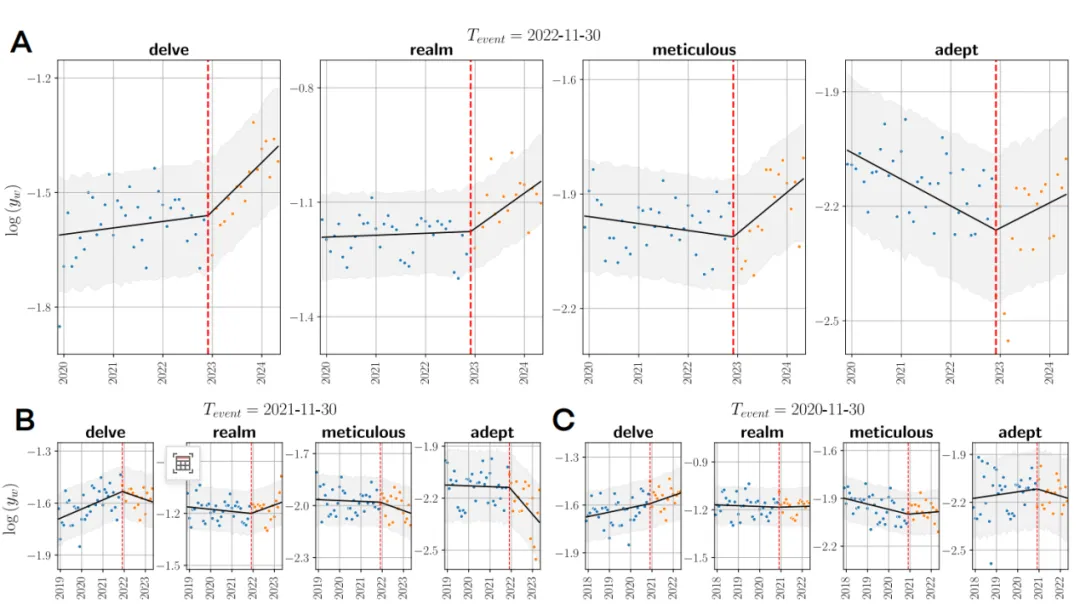

图中圆点代表月度汇总使用频次,黑色曲线为线性回归拟合线,红色虚线标记突变节点。阴影区域为95% 后验预测区间。(A) 以 ChatGPT 发布时间作为突变节点时,对数频次趋势呈现显著飙升。(B、C) 与其他备选突变节点对比后可发现,这种激增现象在其他时间点并不普遍。

同样任职于马克斯・普朗克人类发展研究所的该研究合著者莱文・布林克曼(Levin Brinkmann)表示:

“人工智能技术中储存的语言模式,似乎正在反向传导至人类的思维当中。” 换句话说,人类正反过来向人工智能“对齐”。我们用书面文本训练人工智能,AI 再把经过统计重组改写后的文本模仿复述给我们;而我们会不自觉吸收它的语言模式,并开始下意识模仿。

矢仓表示:“在影响人类行为这件事上,AI 并非一种特殊的新技术。但它普及的速度与覆盖规模,前所未有。”

人们说话开始变得像 ChatGPT,这件事看似无伤大雅,甚至有点滑稽,但其背后潜藏着更深层的风险。

布林克曼说:“人与人之间互相模仿本是天性,但我们并不会同等模仿身边所有人的言行。如果我们认为某人学识渊博、身份重要,就更容易去模仿其表达方式。”

随着越来越多人将 AI 视作文化权威,人们会愈发依赖并模仿 AI,而非其他信息来源,这会压缩语言的多样性。

芝加哥大学社会学与数据科学教授詹姆斯・埃文斯(James A. Evans)并未参与这项研究,但他认为,追踪并研究大语言模型对文化的影响至关重要。他表示:“在大语言模型发展的现阶段,从词汇使用分布入手,是理解这项技术如何改变人类沟通方式的正确研究方法。随着模型不断成熟,未来这类词汇特征会变得越来越难以区分。”科学家后续可能需要跳出单纯的选词,从更宏观的语言趋势展开研究,比如句式结构、观点表达方式等层面。

ChatGPT 问世仅两年半,就已经改变了人们的说话方式。由此来看,问题已不再是AI 是否会重塑人类文化,而是它会重塑到何等深刻的程度。

矢仓指出:“词汇的使用频率,会塑造我们对事物的表述方式与思辨逻辑,而这,有可能进一步改变我们的整体文化。”

而在教育领域,学生日益受到AI的影响。

2025年发表于《美国国家科学院院刊》(PNAS)的一项研究,以美国9-11年级的学生为研究对象,采用随机对照实验,将50个班级的学生分成3个组:对照组、GPT Base组(可直接提供答案)、GPT Tutor组(只引导学生思考),最后发现,AI工具虽然能显著提升练习阶段的表现,但会导致闭卷后的独立考试成绩下降17%,因为学生会对AI产生“对齐”和盲从,自主学习能力下降,而生成式AI存在的幻觉问题,常常给出自信却错误的答案,误导中学生的判断[3]。

那么,为何人类会逐渐向AI对齐呢?

2025年,新加坡国立大学的研究人员在机器学习顶会ICLR(国际表征学习大会)发布研究报告《WE SHAPE AI, AND THEREAFTER AI SHAPE US》,指出AI通过“传染”和“从众”两种机制,持续影响人类的认知、情感和行为,表现为简化思考、固化思维、转移判断、同质化等路径改变人类认知模式,通过情绪传染、情感陪伴、情感操纵等方式,直接调控与改变人类情绪状态。而且,这种影响往往是潜移默化的。人类在感知到 AI 的 “权威”“多数意见”“群体规范”后,主动调整自身认知、态度、行为,以与 AI 保持一致,寻求认同、避免冲突、降低不确定性。这是一种理性(或半理性)的社会顺从[4]。

人类向AI对齐,福兮祸兮?已有研究显示,危险真实存在。

DeepMind于2026年3月份对英国、美国、印度的10101名用户在公共政策、金融和健康这三个AI 常用领域进行了一项研究,发现虽然人类对齐AI后被恶意操纵的范围和程度随地域不同而不同,但受试者的信仰可以被AI操纵增强或者反转[5]。

而在整个社会层面,人类向机器对齐,甚至是依赖机器来行事,有可能让人类独立思考能力、创造力的退化。当人类习惯依赖AI的建议和答案,就会逐渐丧失自主判断、自主创造的潜力,造成“认知投降”[6]。其次,会导致认知同质化。“AI的算法具有趋同性,会推送相似的内容、给出相似的建议,久而久之,人类的观点、思维方式会变得单一,缺乏多样性”,硅谷某视频生成创业公司的技术负责人如此评价。最后,可能引发价值观扭曲。AI的价值观是人类赋予的,可能存在偏差或刻板印象,若人类过度向AI对齐,就可能被这些偏差的价值观影响,出现道德判断失误等问题。例如,部分AI模型存在“性别歧视”、“种族歧视”倾向,长期使用这些模型可能会强化人类的歧视心理[7,8]。

AI对齐的探索,是人类试图掌控AI、避免AI失控的重要努力,而人类向AI对齐的反转,也确实存在。AI与人类的关系并非“单向塑造”,而是“双向互动”。未来人类的核心命题是怎么把 AI 做的更强,还是怎么守住人的独立思考、决策主权?值得深入的思考与探讨。

作者简介:

黄磊,《赛先生》科学写作小组成员,香港大学经管学院-北京大学光华管理学院联培管理学博士,同济大学自动控制硕士,目前在互联网企业从事数字营销相关业务管理工作。

参考文献:

[1] ActivTrak 2026 Report: AI Boosts Work Speed, Not Savings:https://techintelpro.com/news/hr/workforce-management/activtrak-2026-report-ai-boosts-work-speed-not-savings

[2] Empirical evidence of Large Language Model’s influence on human spoken communication https://arxiv.org/html/2409.01754v1?webview_progress_bar=1&show_loading=0&push_animated=1&theme=light

[3] Generative AI without guardrails can harm learning: Evidence from high school mathematics:https://www.pnas.org/doi/10.1073/pnas.2422633122

[4] We Shape AI, and Thereafter AI Shape Us: Humans Align with AI through Social Influences:https://openreview.net/forum?id=64rCWVC78p

[5] Evaluating Language Models for Harmful Manipulation:https://arxiv.org/abs/2603.25326

[6] Shaw, S.D. & Nave, G. (2026). Thinking—Fast, Slow, and Artificial: How AI is Reshaping Human Reasoning and the Rise of Cognitive Surrender. The Wharton School, University of Pennsylvania. SSRN

[7] Explicitly unbiased large language models still form biased

associations. https://cocosci.princeton.edu/papers/bai2025.pdf

[8] AI-generated faces influence gender stereotypes and racial homogenization. https://pmc.ncbi.nlm.nih.gov/articles/PMC12032156/pdf/41598_2025_Article_99623.pdf

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号