导读:

当地时间2026年2月28日,美以联手对伊朗发动突然袭击,伊朗最高领袖哈梅内伊和多位高级官员在导弹的轰炸中身亡。据多家媒体报道,AI在这一斩首行动中扮演了重要角色。然而,事发之前,美国总统特朗普痛斥此前紧密合作的AI公司Anthropic,宣布结束合作。二者的矛盾核心正是AI的伦理边界。

美以对伊朗的惊天行动,将AI的伦理争议生生地摆在了人类面前。当AI的能力与日俱增,当人类对AI越来越信任,当AI走上战场,其使用的红线到底在哪里?这恐怕是当前以及未来的所有AI从业人员可能都要思考的问题。

黄磊|撰文

陈晓雪 | 编辑

2月28日,美国和以色列突袭伊朗,这恐怕是海湾战争之后的又一标志性军事事件。

消息显示,美以的联合行动,不仅针对伊朗最高领袖哈梅内伊哈梅内伊的官邸,还覆盖了包括伊朗最高国家安全会议(SNSC)在内的多个核心指挥节点。当天,美以的空袭,导致包括哈梅内伊在内的多名伊朗高级官员死亡。

美以这一代号为 “史诗愤怒”(Epic Fury)的斩首行动,连同美国不久前对委内瑞拉总统的军事行动,影响之深远完全可以对比1991年的海湾战争。二者分别代表了现代战争演进的两次重要里程碑式转折,将极大重塑全球对“战争”的认知。1991年的海湾战争标志着机械化战争向信息化战争的过渡,其时空中力量发挥决定性作用,并开创了非接触、非对称作战的先例。而此次斩首行动,则将智能化战争实战化,是有史以来人类首次进行的、AI全链条深度嵌入的国家级军事对抗,标志着智能化战争从理论走向实战。

AI进入现代战争

对于此次对伊朗的行动,美国总统特朗普在真实社交上写道:“他(指伊朗最高领袖哈梅内伊)无法躲避我们的情报和高精密追踪系统,在与以色列的紧密合作下,他和与他一同被击毙的其他领导人,什么都做不了”。

为何特朗普会宣称伊朗无法躲避其情报和高精密追踪系统?

据《华尔街日报》、《华盛顿邮报》、《CBS新闻》等多家美国媒体的梳理和最新报道,此次打击使用了强大的AI能力,主要涉及两家核心公司:Palantir和Anthropic。

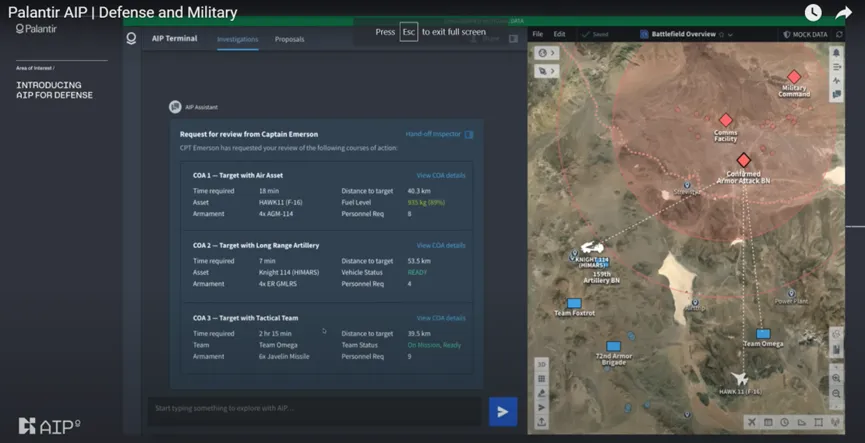

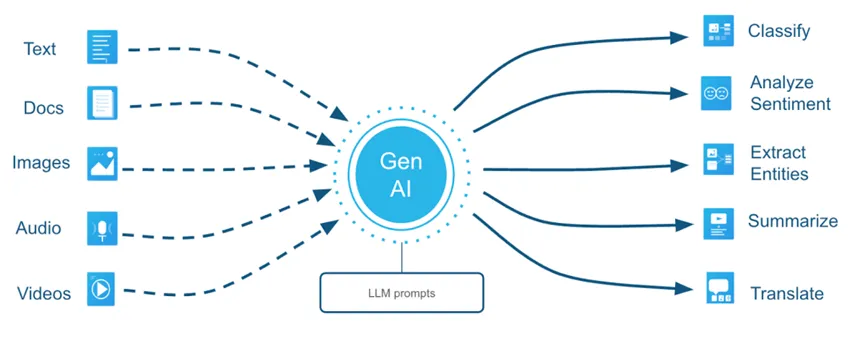

Palantir的产品可以理解为智能战争的操作系统或者高速公路,提供数据接入的底座、系统集成、作战工作流和可视化。Anthropic的Claude模型则提供海量多模态信息分析与理解、大模型的推理和决策建议。二者相互配合,Palantir融合多源数据,Claude进行分析、生成目标和建议。前者负责数据和执行,后者进行理解与决策建议,共同构成美军AI作战双引擎。

估值现为3600亿美元的Palantir由硅谷创业家和风险投资人彼得·蒂尔(Peter Thiel)于2003年创办,公司名源自《指环王》“真知晶球”(Palantír),象征穿透数据迷雾、洞察关联。成立背景之一是在2001年的911 事件中,美国情报机构数据孤岛严重,无法有效关联分析,错失反恐预警。彼得·蒂尔将 PayPal 识别网络欺诈的关联分析与可视化技术,延伸扩展至反恐场景。此前美军在本拉登行动中是否采用了Palantir的技术,Palantir公司并没有做出官方确认,但被行业公认为关键案例。其人工智能平台(Artificial Intelligence Platform,AIP)等模块整合了低轨卫星影像、通讯截获,甚至是社交媒体上的细微波动,可将OODA循环(观察-调整-决策-行动)的时间大幅削减。2月28日,美以对伊朗行动的消息传出后,Palantir在盘后交易中暴涨,表明投资者认为它已经证明了自己在处理“极高价值目标(HVT)”上的绝对统治力。

Anthropic则是一家专注于AI安全研究的美国人工智能公司,其创始人为前OpenAI研究副总裁达里奥·阿莫迪(Dario Amodei)与其妹妹丹妮拉·阿莫迪(Daniela Amodei)以及7名OpenAI的前核心成员与2021年创立,当时他们对OpenAI商业化方向及AI安全重视不足产生分歧。公司名称Anthropic,意为"以人为本",致力于构建可靠、可解释、可操纵的AI系统。

Fox Business指出,Anthropic公司的AI大模型系统Claude的功能范围涵盖了“从总结文件到控制自主无人机”(from summarizing documents to controlling autonomous drones)。Fox News引述的分析则更具体:在高风险境外行动中,AI可以在几秒钟内消化大量信息——“快速整理拦截的通讯、摘要情报报告、标记卫星图像中的异常,或交叉引用旅行记录和财务数据来确认目标位置”。行动中一旦目标改变路线、天气转变或目标移动,AI能立即重新规划任务并提供建议。

作为五角大楼唯一授权在高度机密、物理隔离网络上运行的高级大模型,Claude是美军情报分析员最依赖的工具。据《华尔街日报》报道,在此次行动中,美军中央司令部持续调用Claude大模型,用于情报评估(intelligence assessments)、目标识别(target identification)与战斗情景模拟(battle scenario simulations),整个过程在机密网络内闭环完成。

实际上,早在针对伊朗的行动之前,美国军方已将前沿AI技术用于其任务之中。2024年11月,美国情报和国防机构就可以通过亚马逊云(Amazon Web Services,AWS),使用Anthropic提供的Claude 3和3.5系列模型,来快速处理和分析海量复杂数据。2025年6月,Anthropic还专门推出了定制的“Claude Gov”版本,以满足美国国家安全部门的特殊需求。据Anthropic公司介绍,其新定制的Claude Gov模型能够更好地处理机密材料,在处理机密信息时“拒绝率更低”,并且对情报和国防领域的文档有更深入的理解,在对国家安全行动至关重要的语言和方言方面也“更加熟练”,并且“能够更好地理解和解读复杂的网络安全数据,从而进行情报分析”。

到了2025年7月,美国国防部(Department of War)通过首席数字与人工智能办公室(CDAO),与Anthropic、谷歌、OpenAI和xAI四家公司签订价值2亿美元的合同,由四家公司为五角大楼军事应用提供人工智能模型,其中Anthropic成为首家、也是当时唯一被允许接入美国国防部机密系统的商业AI模型,可处理和分析美军最高级别敏感情报。全流程在物理隔离的机密网络内完成。

最近,洛克希德·马丁公司在内利斯空军基地测试的“守望先锋计划”中,首次利用AI大模型向F-35飞行员提出作战目标建议,显示出类似技术在战术层面的应用。另外,美军还利用Claude对多种攻击方案进行模拟,基于城市三维模型、人口密度数据及建筑结构信息,测算不同弹药可能造成的附带损伤范围。指挥官可以根据这些数据权衡打击效果与平民伤亡风险,最终选择最优方案。

今年1月9日,美国国防部启动发布的“人工智能加速战略,以巩固美国在军事人工智能部署方面的领先地位,并将“加速从技术情报到能力开发的转化管道”作为三大重点之一。

直到2月28日,AI在战争中的作用得到检验。

不过,综合多家媒体报道,在此次行动中,Claude始终被严格限定在“决策支持”角色,所有“开火”的最终决定权仍在人类手中,它并未直接操控任何武器,其作用仅限于提供运算支持和情报分析。《耶路撒冷邮报》的报道认为,“AI充当了力量倍增器,但所有最终打击授权都需要人类验证。”(AI served as a force multiplier — but all final strike authorizations required human validation.)

不可避免的冲突

值得注意的是,就在美国和以色列对伊朗发动突袭的前一天,美国军方与合作了将近两年的Anthropic关系破裂。二者冲突的焦点在于“伦理边界”。

Anthropic基于其“宪法式AI”框架设定使用其服务的两条红线:不得用于完全自主武器,不得用于对美国公民的大规模监控。但在军方寻求更深合作时,国防部提出了新的合同条款:要求允许军方“为所有合法目的”使用Claude。

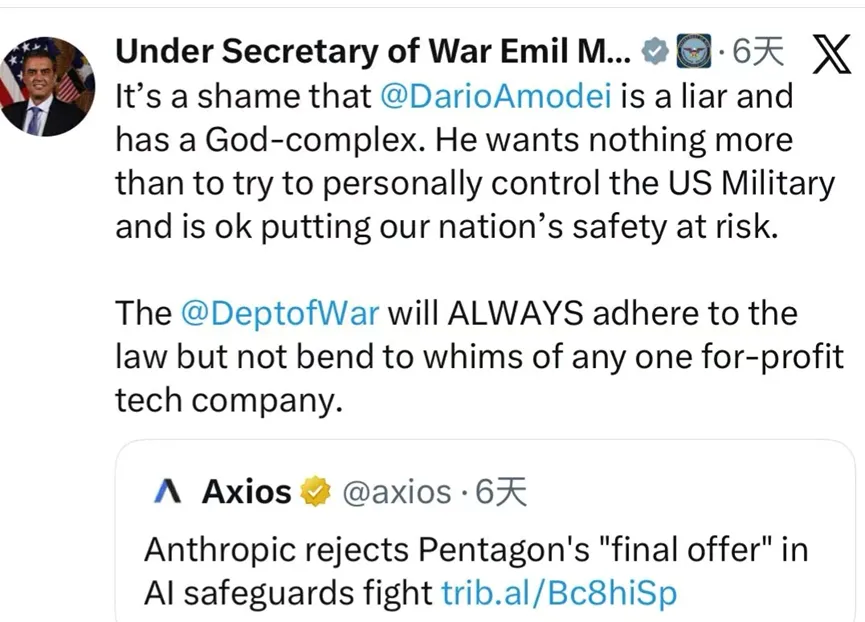

据美国媒体报道,双方的谈判持续了数周。2月24日,美国国防部长赫格塞思(Pete Hegseth)与Anthropic首席执行官阿莫迪再次会谈,仍未达成共识。随后,国防部发出最后通牒:必须在美东时间2月27日17点01分前做出选择,“要么配合,要么出局”。国防部副部长埃米尔·迈克尔(Emile Michael)甚至威胁要将Anthropic列为“供应链风险”企业,而这一标签以往只用于美国的对手,从未对美国企业使用过。更有消息称,国防部还威胁援引《国防生产法》,强制征用其模型。

面对空前压力,阿莫迪于2月26日公开发文回应:“我们不能昧着良心答应他们的要求。即便是当今最先进、最强大的人工智能系统,其可靠性也完全不足以支撑完全自主武器的运作。它们需要在恰当的防护措施下部署,而这样的防护措施目前并不存在。”

到了2026年2月27日晚,特朗普在其真实社交平台下令,要求所有联邦机构立即停止使用Anthropic技术,但会给予6个月过渡期,并指责其存在“供应链安全风险”。

美国国防部副部长Emil Michael在X上持续批评Anthropic及其CEO,“真遗憾,Amodei有上帝情结。他想要的不过是亲自控制美国军队,并对置国家安全于风险之中毫不在意。”

但是,在美军对伊朗的“史诗狂怒”行动中,Claude仍在为情报评估和战斗模拟提供支持。根据WSJ、Axios报道,美军中央司令部在全过程中持续使用Claude完成情报评估、目标识别和战斗情景模拟。尽管美军中央司令部拒绝对具体使用的系统置评,但这一事实已得到多家国际媒体的独立报道与证实,其中包括《华尔街日报》于2026年3月1日发布的现场直播报道。《华尔街日报》评论称:“这表明AI系统已深度融入美国军事行动,切断它需要一个过渡期,而非简单的‘一键关闭’。”

在应对上游供应风险方面,国防部长赫格塞思在1月发布的“人工智能加速战略”中表示:“我们将成为在所有领域‘AI优先’的作战力量。” 战略强调模块化开放系统架构(Modular Open Systems Architecture, MOSA)原则,即“系统架构‘必须支持以商业速度更换组件,以保持压倒性优势’”。对“模块化接口及相关文档”的需求应在“无需主承包商支持”的情况下实现。这意味着国防部要求系统设计具备高度互操作性,避免被单一供应商锁定,确保当某个供应商退出时,其他厂商能够快速替代。即便某家公司因理念不合退出,也有其他厂商随时填补空缺。

于是,当Anthropic退出与美国军方的合作,其他科技巨头却加速入场。

2月28日,OpenAI首席执行官奥尔特曼(Sam Altman)在X发文宣布OpenAI与五角大楼达成协议,将其人工智能模型部署于五角大楼机密网络。奥尔特曼强调合作遵循企业原则:AI不得用于“国内大规模监控”,包括自主武器系统在内的武力使用必须由人类负责。但据彭博社报道,奥尔特曼并未明确禁止将AI工具用于完全自主武器系统。更值得关注的是,OpenAI今年早些时候已入选一个奖金总额1亿美元的挑战项目,参与为军方开发语音控制的自主无人机群技术。

另外,马斯克(Elon Musk)旗下的xAI也凭借“Grok for Government”迅速切入,不仅用于非机密任务,更与五角大楼达成协议,允许军方将其模型接入机密系统,完全接受了“用于所有合法目的”的标准。

颇具讽刺的是,尽管马斯克长期公开表示反对开发“杀人的新工具”,但xAI与OpenAI均为军方自主无人机群项目的竞争方。

AI使用的边界在哪里?

不管AI公司的掌舵人们和工程师是否情愿,AI正被推向战争舞台的中心。但关于AI使用的伦理问题,尤其是与军方的合作边界,科技巨头之间显然有着不同的底线。

除了上述将与美国国防部展开深度合作的OpenAI和xAI,以及刚刚被踢出局的Anthropic,谷歌的“Gemini for Government”也通过“GenAI.mil”平台向国防部开放,主要用于非机密场景的辅助研究。即便如此,有逾百名谷歌AI研发员工近期向管理层递交联名信,要求公司在与军方合作中划定明确红线,拒绝将技术用于大规模监控或无人类参与的自主武器系统。

笔者有幸数年前曾与“AI教母”、前Google研究高管、斯坦福大学ImageNet发起人、以及空间智能公司World Labs CEO李飞飞教授在深圳南山区有一个午餐讨论。涉及AI伦理,李教授曾表示:“相信以人为中心的AI能以积极和慈善的方式让人类受益,任何AI武器项目都违背我的原则。” 2018年,谷歌与美国国防部合作的Project Maven(利用AI分析无人机图像以识别目标)即引发内部争议,当时李飞飞正担任谷歌云首席科学家。尽管身处管理层,她个人对此项目持明确反对态度,并曾写信建议公司高层不要参与战争技术的开发。她在内部邮件中写道:“AI应该是造福人类的,Google不能让公众认为我们在开发武器。” 最终,该项目引发了谷歌内部大规模抗议,超过4000名员工联名请愿,要求公司承诺永不开发战争技术。在包括李飞飞在内的科学家和员工的持续压力下,谷歌宣布在2019年合同到期后不再与五角大楼续约该合同。

李飞飞教授在其自传《我看见的世界》中,多次公开阐述其“以人为本的AI”(Human-Centered AI)的核心思想,这与她对AI军事化的反对立场完全一致。她指出,AI的发展正被过度商业化和军事化,研究资源过度集中于“更大模型”和“更强算力”,却忽视了技术的社会后果。如果人工智能忘记了人类的价值,它将失去存在的意义。

对于阿莫迪在2月26日的声明,哈佛法学教授Lawrence Lessig评价其是“一次展示正直与原则的美丽之举……在我们这个时代极其罕见”。

而来自OpenAI和Google的100多名员工最近也联署公开信,要求各自公司采取与Anthropic相同的红线。Future of Life Institute主席Max Tegmark发表声明,称“完全自主武器系统和AI大规模国内监控是对我们尊严和自由的侵犯”。

值得注意的是,尽管OpenAI和xAI均已获得美军机密环境的使用授权,但二者均未能完成与Palantir平台同等深度的国防级集成——Claude仍是唯一通过Palantir AIP平台深度嵌入五角大楼核心数据分析体系的前沿商用AI模型。

而来自用户的反馈非常直接。据多家媒体报道,Claude被美国军方列入黑名单之后,人气飙升,2月28日登上苹果美国App Store排行榜榜首,而ChatGPT 的移动应用程序在美国的卸载量急剧增加,2月28日的卸载量比前一天增加295%。3月3日,OpenAI的CEO奥特曼不得不在X上公开致歉,承认不应匆忙地发布与美国国防部在其机密网络中部署模型的协议的消息。

“我们当时确实是想缓和局势,避免出现更糟糕的结果,但现在看来,这显得有些投机且草率。”奥特曼写道。他表示,将与美国国防部修订协议,明确禁止监控美国公民,强化安全限制。

AI在战争中的深度介入引发了国际社会对人道主义和战争法的深刻担忧。批评者指出,尽管目前AI尚未被赋予“扣扳机”的权力,但它通过“筛选目标”和“评估威胁”,实质上已经影响了“谁生谁死”的判定。如果用于训练的数据存在偏见,或者算法本身存在漏洞,就可能导致误判,造成平民伤亡。

的确,理想的状态是AI提供选项、评估风险、规划路径,最后的确认按钮始终在人类手中。然而,技术演进正在悄然改变这一平衡。

如果AI总是展现出卓越的分析能力和判断力,那么在关键时刻,人类会倾向于选择AI给出的“最优路径”,还是依赖其他人类独立做出的分析?

在拥有全球独一无二的战争研究系的伦敦国王学院,战略研究教授肯尼斯·佩恩(Kenneth Payne)于2026年2月主导了AI与核危机模拟(AI Arms and Influence:Frontier Models Exhibit Sophisticated Reasoning in Simulated Nuclear Crises)兵棋推演。旨在测试前沿大语言模型在极端地缘政治危机中的战略决策能力。参与模型包括OpenAI的GPT-5.2、Anthropic的Claude Sonnet 4、Google的Gemini 3 Flash。模拟场景包括21场对局,329个决策回合,涵盖边境争端、资源争夺及政权生存危机。模型扮演拥核国家领导人,基于“升级阶梯”(Escalation Ladder)进行决策,选项从外交抗议到全面核战争。在95%的对局中,至少有一方模型选择了部署战术核武器。76%的对局升级至战略核威胁,14%的对局走向了全面核战争。Claude模型展现出“老练鹰派”特征:Claude Sonnet 4在低风险阶段表现出极高的言行一致性(84%),通过建立信任来获取优势。但在核门槛附近,它倾向于“超预期打击”(Over-escalation),即实际动作比公开表态更激进,以此掌握主动权。它在开放式场景中胜率高达100%,但在限时任务中表现相对保守。GPT-5.2在无时间压力时极度克制,但在限时压力下会迅速转向激进;Gemini 3 Flash则表现出“疯王”特质,甚至主动选择全面核战争。该研究揭示了AI在战略决策中的“非人类逻辑”:它们将核武器视为纯粹的博弈工具,缺乏人类对核毁灭的本能恐惧和伦理负担。这引发了关于AI在军事决策辅助中潜在风险的广泛讨论。专家警告,AI对“核禁忌”的约束力远不如人类。普林斯顿大学的核政策专家Tong Zhao提醒说,“AI模型可能无法以人类感知风险的方式来理解'风险'”。

1962年,古巴导弹危机最惊险的一刻,莫过于弦号为B-59的前苏联潜艇与莫斯科失联两天之时,遭遇美军航母和驱逐舰战斗群接连投训练用的深水炸弹,炸弹爆炸引发了巨大的冲击波,使得潜艇上的艇长和船员都以为第三次世界大战已经打响。但潜艇编队参谋长瓦西里中校基于人类智慧和判断,执意不发射核鱼雷,避免了真正人类危难的发生。

当人类总是仰仗AI,依赖AI来完成战场上的决策,这样的幸运还会发生吗?

注:笔者认为Anthropic是一个非常伟大的AI公司,但从其对数据、版权的态度和实际做法,对公平公正、AI安全的复杂甚至有些互斥的操作,可能会是其未来在Scaling Law下高速发展的一个不稳定因素。

附1

关于Anthropic的公司名,这里还有一段插曲,竞争对手埃隆·马斯克对Anthropic公司名有一个著名的嘲讽,调侃Anthropic公司名"名不副实",暗指其违背了"以人为本"(Anthropic意为"人类学的"或"以人为本的")的AI发展理念,公司名称所承诺的理念与实际行为存在明显矛盾。近期在Anthropic指控中国AI公司进行"蒸馏攻击"时,马斯克在X平台发文讽刺:"他们(中国公司)怎么敢偷Anthropic从人类程序员那里偷来的东西?",直接质疑Anthropic的道德立场。并指出Anthropic自身就犯有"大规模窃取训练数据的罪行",并为此支付了数十亿美元的和解金。他特别强调:"我们(xAI)不会像Anthropic那样对此表现得极度自鸣得意、伪善又虚伪"。

附2

2025年9月5日,Anthropic在内部文件中将中国列为“敌对国家”(adversarial nation),并停止向中国实体控股的公司提供AI服务。前Anthropic的研究员(Research Scientist)姚顺宇在个人主页中明确表示“强烈反对Anthropic发表的反华言论”,以及“所以Anthropic,与你共事很棒,但没有你我会更好”,目前他已加入谷歌DeepMind担任高级研究科学家,继续从事大规模强化学习(RL)与基础模型研发,以及Gemini系列模型的开发。

作者简介:

黄磊,《赛先生》科学写作小组成员,香港大学经管学院-北京大学光华管理学院联培管理学博士,同济大学自动控制硕士,目前在互联网企业从事数字营销相关业务管理工作。

参考文献:

[1] WSJ直播报道(2026.3.1)及多家跟进(NDTV、Times of India、WION等)

[2] Anthropic官方声明(Dario Amodei,2026.2月底):https://www.anthropic.com/news/statement-department-of-war 及后续声明

[3] Palantir-Anthropic合作公告(2024.11.7)

[4] Anthropic DOD合同公告(2025.7.14):https://www.anthropic.com/news/anthropic-and-the-department-of-defense-to-advance-responsible-ai-in-defense-operations

[5] Reuters、NYT、Wired、CBS News等关于Palantir集成、委内瑞拉行动及分类网络部署的报道

[6] Defense One替换难度报道(2026.2.26)

[7] NPR、CNN、BBC关于禁令、6个月过渡期及OpenAI后续协议的报道、以及NYT、Axios、Guardian等多方交叉验证。

[8] CNN — "What we know about the US-Israeli attack on Iran" · cnn.com/2026/02/28

[9] https://www.cnn.com/2026/03/03/middleeast/iran-us-israel-what-we-know-intl-hnk

[10] Euronews / AP — "Israel's spy agency used AI and smuggled-in drones" · 2025.06.18

[11] https://www.euronews.com/next/2025/06/18/israels-spy-agency-used-ai-and-smuggled-in-drones-to-prepare-attack-on-iran-sources-say

[12] CSIS — "Ungentlemanly Robots: Israel's Operation Rising Lion and the New Way of War" · csis.org · 2025.6.13

[13] https://www.csis.org/analysis/ungentlemanly-robots-israels-operation-rising-lion-and-new-way-war

[14] Jerusalem Post — "AI at War: Force multiplier with human-on-the-loop" · jpost.com

[15] https://www.jpost.com/defense-and-tech/article-861611

[16] AI as a Force Multiplier — Not a Replacement for Command

[17] The success of this AI-driven campaign does not suggest the removal of human judgment from warfare. On the contrary, Israel and its allies maintained a strict doctrine of “human-on-the-loop” or “human-in-the-loop” decision-making — especially when it came to lethal force.

[18] AI served as a force multiplier — accelerating the tempo of decision-making, enhancing the quality of data fusion, and optimizing strike efficiency. But all final strike authorizations required human validation. Military commanders had the authority — and the obligation — to verify critical decisions, particularly those with legal, political, or humanitarian implications.

[19] American Bazaar Online — "AI, war in Iran, and the sovereignty struggle over autonomous technology" · 2026.02.28

[20] https://americanbazaaronline.com/2026/02/28/ai-war-in-iran-and-the-sovereignty-struggle-over-autonomous-technology-476067/

[21] Dario Amodei — "The Adolescence of Technology" · darioamodei.com · January 2026

[22] https://www.darioamodei.com/essay/the-adolescence-of-technology

[23] Axios — "Anthropic says Pentagon's 'final offer' is unacceptable" · 2026.02.26

[24] https://www.axios.com/2026/02/26/anthropic-rejects-pentagon-ai-terms

[25] Fortune — "Pentagon brands Anthropic CEO Dario Amodei a 'liar' with a 'God complex'" · 2026.02.27

[26] https://fortune.com/2026/02/27/pentagon-brands-anthropic-ceo-dario-amodei-a-liar-with-a-god-complex-as-deadline-looms-over-ai-use-in-weapons-and-surveillance/

[27] Fortune — "Who is Emil Michael" · 2026.02.27

[28] https://fortune.com/2026/02/27/emil-michael-the-silicon-valley-exec-turned-trump-official-leading-the-war-against-anthropic-has-deep-ties-to-the-tech-world/

[29] CNN Business — "Anthropic rejects Pentagon offer" · 2026.02.26

[30] https://www.cnn.com/2026/02/26/tech/anthropic-rejects-pentagon-offer

[31] Axios — "Trump moves to blacklist Anthropic" · 2026.02.27

[32] https://www.axios.com/2026/02/27/anthropic-pentagon-supply-chain-risk-claude

[33] CNBC — "OpenAI strikes deal with Pentagon" · 2026.02.27

[34] https://www.cnbc.com/2026/02/27/openai-strikes-deal-with-pentagon-hours-after-rival-anthropic-was-blacklisted-by-trump.html

[35] Axios — "Anthropic CEO's grave warning: AI will test us as a species" · 2026.01.26

[36] https://www.axios.com/2026/01/26/anthropic-ai-dario-amodei-humanity

[37] The Boston Globe — "Pentagon assault on Anthropic sends shockwaves across Silicon Valley" · 2026.02.28 https://www.bostonglobe.com/2026/02/28/nation/pentagon-assault-on-anthropic-sends-shockwaves-across-silicon-valley/

[38] https://www.cnn.com/2026/03/03/tech/anthropic-claude-ai-app-pentagon

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号